Responsabilidade das plataformas digitais por conteúdo ilegal é o tema que dominou os debates sobre liberdade de expressão e regulação da internet no Brasil em junho de 2025. O Supremo Tribunal Federal (STF) decidiu que empresas como Facebook, TikTok e X (antigo Twitter) podem ser responsabilizadas civilmente se não removerem publicações manifestamente ilícitas, mesmo sem ordem judicial.

Neste artigo, você vai entender:

- O que a decisão muda na prática

- Por que isso afeta criadores, empresas e usuários comuns

- Quais riscos e oportunidades surgem neste novo cenário

O que motivou a decisão do STF?

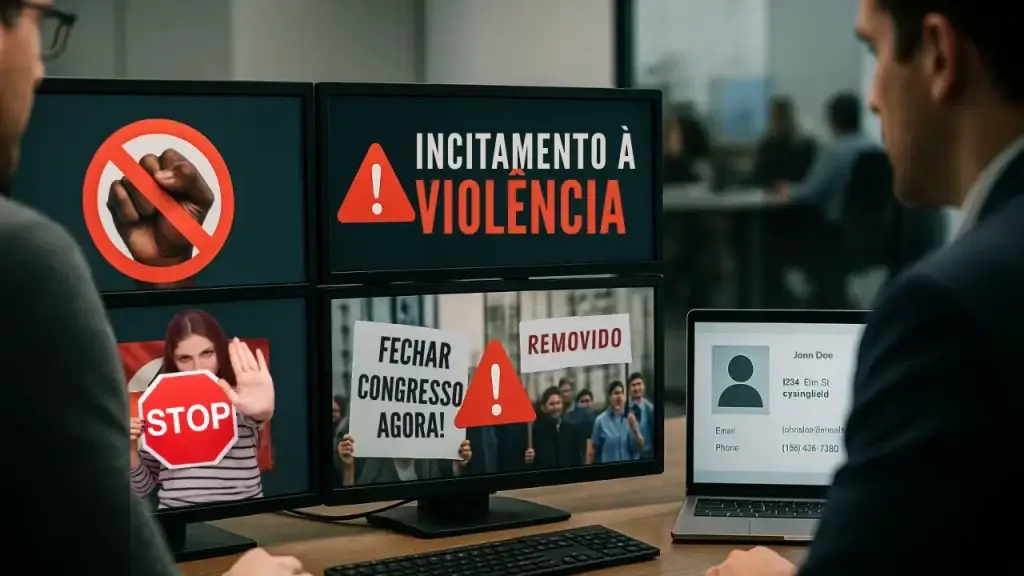

O processo que culminou nessa decisão começou com ações judiciais movidas por pessoas vítimas de discurso de ódio e desinformação. Durante os últimos anos, casos de fake news, incitação à violência e ataques antidemocráticos cresceram exponencialmente.

Antes da decisão, a regra era clara: as plataformas só eram obrigadas a retirar conteúdos mediante decisão judicial. Isso dava tempo e segurança jurídica, mas também permitia que publicações ofensivas ficassem meses no ar.

Agora, o Supremo entendeu que conteúdos manifestamente ilegais — como ameaças de morte, racismo, defesa de golpes de Estado — devem ser removidos imediatamente, a partir de simples notificação de qualquer usuário.

Como fica a responsabilidade das plataformas digitais por conteúdo ilegal?

Responsabilidade das plataformas digitais por conteúdo ilegal passa a ser objetiva em casos de inércia. Isso significa que se a empresa tomar conhecimento de uma publicação ilegal e não agir com rapidez, poderá:

- Pagar indenizações por dano moral e material

- Receber multas administrativas

- Ser alvo de novas ações judiciais coletivas

O STF fixou que a obrigação é de “pronta remoção”, principalmente quando há evidência clara de ilegalidade, dispensando ordem judicial.

O que são conteúdos manifestamente ilegais?

Para evitar interpretações amplas demais, a decisão listou exemplos de conteúdos que exigem remoção imediata:

- Racismo e injúria racial

- Apologia ao nazismo

- Incitação à violência ou homicídio

- Defesa do fechamento do Congresso ou do STF

- Divulgação de dados pessoais sem consentimento (doxing)

Outros conteúdos polêmicos, como desinformação sobre vacinas ou política, poderão ter análise caso a caso.

Impactos para usuários e criadores de conteúdo

Essa mudança afeta todos que produzem ou compartilham conteúdo na internet:

- Criadores de conteúdo: precisarão revisar com atenção publicações, memes e comentários, pois qualquer denúncia pode levar à retirada imediata.

- Empresas: marcas que fazem campanhas digitais devem redobrar checagem para evitar conteúdos potencialmente ilícitos.

- Usuários comuns: podem usar o mecanismo de denúncia com mais força, mas também devem ter cuidado para não compartilhar links ofensivos.

Riscos de censura e abuso

Organizações de defesa de direitos civis apontaram riscos de censura privada, pois plataformas podem preferir remover conteúdos preventivamente para não se expor a processos.

Há também possibilidade de uso político das notificações, com grupos organizados denunciando perfis opositores em massa.

Essa tensão entre responsabilidade e liberdade de expressão já é chamada por especialistas de “efeito silenciador”, quando empresas retiram conteúdo por excesso de cautela.

Por que o Brasil pode se tornar referência internacional?

O Brasil é um dos primeiros países democráticos a aprovar jurisprudência tão ampla de responsabilidade das plataformas digitais por conteúdo ilegal.

Isso coloca o país no centro do debate global sobre:

- Como as redes sociais devem moderar conteúdos

- Até onde vai a responsabilidade civil

- Qual o equilíbrio entre liberdade e segurança

O tema interessa a outros governos que também enfrentam o crescimento de discursos de ódio e fake news.

Quais medidas as empresas precisarão tomar?

Empresas terão que:

✅ Criar fluxos internos de avaliação rápida de denúncias

✅ Treinar equipes para identificar conteúdos manifestamente ilegais

✅ Manter registros de remoções e justificativas para eventuais ações judiciais

✅ Notificar o autor da postagem sobre a decisão de retirada

Grandes plataformas já anunciaram planos de aumentar times de moderação no Brasil.

Como a decisão afeta a publicidade digital?

A decisão do STF sobre responsabilidade das plataformas digitais por conteúdo ilegal também impacta diretamente marcas, agências de marketing e anunciantes. Isso porque, ao aumentar a pressão sobre as plataformas para moderar conteúdos, todo o ecossistema publicitário passa a operar sob regras mais rígidas e fiscalização ampliada.

Veja como isso pode afetar seu planejamento de mídia digital:

1. Bloqueio de anúncios vinculados a páginas denunciadas

Se sua marca patrocinar conteúdos de criadores ou páginas que recebam notificações por conteúdo manifestamente ilegal — mesmo que em outros posts — os anúncios podem ser suspensos automaticamente. As plataformas estão desenvolvendo mecanismos de blacklist e restrição preventiva, para evitar responsabilidade solidária.

Exemplo prático:

Uma loja que faz publicidade em um perfil que publica fake news sobre vacinas pode ter toda a campanha pausada, mesmo que o anúncio não trate do assunto.

2. Segmentação de públicos sensíveis sob vigilância

Campanhas direcionadas a temas considerados sensíveis — como religião, política, saúde e questões raciais — deverão passar por processos adicionais de auditoria. As plataformas vão exigir comprovação de que os anúncios não contêm ou financiam discurso de ódio, desinformação ou incitação à violência.

O que pode mudar:

- Mais exigências documentais ao criar campanhas (por exemplo, declarações de responsabilidade).

- Aumento do tempo de aprovação dos anúncios.

- Maior chance de reprovação automática por palavras-chave que remetam a temas delicados.

3. Estratégias de remarketing com regras mais estritas

O remarketing — prática de exibir anúncios a quem já interagiu com seu site ou perfil — pode ser impactado por novas restrições de coleta e uso de dados em páginas denunciadas. Isso porque, se o ambiente em que o remarketing ocorre estiver sob investigação, os públicos personalizados podem ser temporariamente bloqueados.

Dicas para minimizar riscos:

- Monitore a reputação dos perfis parceiros e páginas que recebe tráfego.

- Avalie usar listas de remarketing baseadas em seu próprio site (first-party data).

- Mantenha registros de consentimento claro de uso de dados.

4. Novas obrigações de transparência e compliance

Agências e marcas precisarão revisar e formalizar políticas de conteúdo seguro. A decisão incentiva anunciantes a incluir cláusulas específicas em contratos com influenciadores, portais e redes.

Sugestões práticas:

- Crie documentos internos com diretrizes sobre temas proibidos e sensíveis.

- Faça auditorias periódicas no conteúdo patrocinado.

- Informe seu time de mídia e jurídico sobre as novas responsabilidades civis.

5. Potencial aumento no custo de anúncios

Com maior risco jurídico, plataformas podem repassar parte dos custos de moderação e compliance aos anunciantes. Isso pode ocorrer de forma indireta, via:

- Taxas administrativas.

- Elevação dos lances médios em leilões.

- Redução do inventário disponível para certos segmentos.

Em resumo, a nova decisão exige que quem investe em publicidade digital no Brasil adote uma postura proativa e vigilante, para evitar prejuízos e proteger a reputação da marca. Se você trabalha com mídia paga, comece já a revisar seu portfólio de canais e seus contratos comerciais.

Exemplos práticos de responsabilidade imediata

Veja situações hipotéticas que se enquadram na nova regra:

🔹 Caso 1 – Um perfil publica ameaça explícita contra um deputado federal. A plataforma é notificada e não retira em 24 horas. Resultado: pode responder solidariamente por danos.

🔹 Caso 2 – Uma empresa patrocina um influenciador que faz apologia ao nazismo. A plataforma pode remover de ofício e a marca pode ter responsabilidade solidária.

🔹 Caso 3 – Um usuário publica críticas fortes, mas legítimas, contra um político. A decisão não obriga remoção automática se não houver ilicitude evidente.

Oportunidades de inovação e compliance

Apesar dos riscos, a decisão também cria oportunidades:

- Startups podem desenvolver ferramentas de compliance digital e moderação automática.

- Profissionais de direito digital terão alta demanda.

- Criadores de conteúdo poderão se diferenciar com políticas claras de responsabilidade e transparência.

Conclusão: o que esperar do futuro?

A responsabilidade das plataformas digitais por conteúdo ilegal abre um novo capítulo no relacionamento entre Estado, empresas de tecnologia e sociedade.

É provável que nos próximos meses surjam:

- Ações judiciais de alto valor contra Big Techs

- Tentativas de regulamentação no Congresso

- Debates sobre o risco de censura e a necessidade de salvaguardas

Para quem cria conteúdo ou trabalha com marketing digital, este é o momento de se informar e se preparar.

Se você sente que o uso excessivo das redes sociais tem prejudicado seu foco ou sua saúde mental, confira nosso artigo sobre Detox Digital: 7 Hábitos para Recuperar o Foco na Era da Distração.

Além disso, entenda como a hiperexposição a conteúdos tóxicos pode gerar o fenômeno conhecido como Brain Rot na Geração Z e veja estratégias para reverter esse processo.

Veja também: Como cursar IA Generativa e Segurança Digital.

FAQ Perguntas Frequentes

O que é responsabilidade das plataformas digitais por conteúdo ilegal?

É a obrigação legal das redes sociais e sites de retirarem publicações manifestamente ilegais assim que forem notificadas, mesmo sem decisão judicial. Caso não cumpram, podem responder solidariamente por danos.

Quais tipos de conteúdos precisam ser removidos imediatamente?

O STF listou exemplos como:

– Racismo e injúria racial

– Apologia ao nazismo

– Incitação à violência

– Defesa de golpe de Estado

– Divulgação de dados pessoais sem autorização

Isso significa que qualquer crítica pode ser censurada?

Não. O STF determinou que a remoção imediata vale apenas para conteúdos evidentemente ilegais. Opiniões e críticas legítimas continuam protegidas pela liberdade de expressão.

Minha empresa pode ter anúncios bloqueados?

Sim. Se seus anúncios estiverem vinculados a páginas denunciadas por conteúdos ilícitos, a plataforma pode suspender preventivamente campanhas ou limitar segmentações.

Quais cuidados devo tomar como criador ou anunciante?

– Revisar regularmente seus conteúdos e políticas internas

– Evitar temas sensíveis sem fundamentação

– Manter registros de consentimento de uso de dados

– Criar cláusulas de compliance em contratos com parceiros

Sou redatora de entretenimento geral com anos de experiência em artesanato, unindo criatividade e precisão em cada texto. Com uma abordagem leve e informativa, exploro temas diversos e atuais, conectando o leitor a experiências culturais e dicas práticas. Minha formação artística agrega um toque autêntico ao conteúdo, criando conexões com públicos variados.

2 thoughts on “Responsabilidade das Plataformas Digitais e a Decisão do STF 2025”

Comments are closed.